距离“数字科学家”还有多远?从“死记硬背”到“逻辑博弈”

本文来自微信公众号: 深究科学 ,编译:潘展,作者:深究科学

在实验室的幽暗灯光下,科学家常年与实验数据和复杂的理论公式博弈。而如今,一个全新的“协作者”出现在了实验台上。大语言模型(LLMs)已经展示了书写论文、总结文献、甚至是构思复杂实验流程的惊人能力。

然而,当一个AI系统提出一种新的催化剂分子,或是预测了一种全新的蛋白质结构时,我们如何确定它是真的通过“理解”科学原理得出的结论,还是仅仅在进行一场精密的统计游戏?

近日,《科学》杂志探讨了这一核心议题:我们究竟该如何衡量人工智能是否聪明到足以从事科学研究?

从“死记硬背”到“逻辑博弈”

在过去几年中,AI模型在各类学术基准测试中表现出了近乎狂飙的性能。无论是MMLU(大规模多任务语言理解)还是其他通用学科测试,AI的得分屡创新高。然而,这引发了研究界深层的担忧:这些测试是否正在失效?

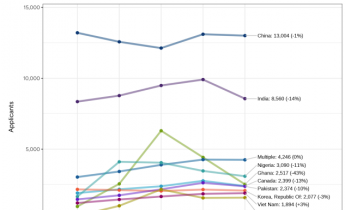

前沿LLMs在流行基准和HLE上的性能,图源:HLE

AI模型在训练阶段几乎“阅读”了互联网上公开的所有科学论文、教科书和在线习题集,许多基准测试题本质上已经成为了模型的“考前背诵材料”。由于目前的AI模型在训练阶段几乎“阅读”了互联网上公开的所有科学论文、教科书和在线习题集,许多基准测试题本质上已经成为了模型的“考前背诵材料”。

当模型面对一道复杂的物理竞赛题时,它给出的正确答案可能并非基于对物理定律的深刻推演,而是基于海量训练数据中的相似模式匹配。也由此,这种“记忆力驱动的智能”在科学研究中是危险的,科学家将它称之为“数据污染”——科学的本质在于探索未知,而记忆只能复述已知。

为了甄别真正的科学智能,研究人员开始设计那些“无法通过互联网搜索找到答案”的极端考题。其中,生物、化学、物理领域的GPQA(研究生级别谷歌验证问答集)成为衡量这一能力的标杆。

各流行模型GPQA分数排行榜,图片来源Frontier

GPQA的独特之处在于其极高的门槛。即使是相关学科的专家,在拥有无限互联网访问权限的情况下,回答这些问题的正确率也仅在65%至70%之间。如果一个非相关领域的博士去参加测试,正确率往往会大幅跌落。

当新一代AI模型(如OpenAI o1系列)在GPQA-Diamond测试中取得超过80%的正确率时,科研界感受到了震动。

他们认为,这不再是简单的记忆检索,而是模型展现出了某种形式的“科学推演能力”——它能够处理多步骤的逻辑链条,在信息不足的情况下进行严谨的外推。

从“结果导向”转向“过程审计”

在科学发现中,结论的正确性固然重要,但推导过程的严谨性往往决定了研究的价值。最新的评估框架开始引入“过程监督”。

FrontierScience奥林匹克与科学研究上各模型准确率,图源:OpenAI

这不仅仅是检查AI最后的答案是否正确,而是要求模型展示其思维路径,如在评估一个AI是否具备合成复杂有机分子的能力时,评估者不再只看最终产量,而是逐一审查AI的每一步操作逻辑:它是否考虑了反应环境的温度与压力?是否识别并避开了可能发生的副反应?在实验失败时,它能否根据异常数据进行正确的归因分析?

这种方法有力地剔除了“逻辑幻觉”。许多模型在测试中能够写出优美的科研术语,但在严密的逻辑审查下,其推导链条往往存在致命的科学漏洞。

从“实战测试”到回归科学的本质

衡量AI性能的最终战场是真实的实验室。目前,最前沿的评估方式被称为“闭环自动化发现”。

在这种模式下,AI被直接连接到自动化的化学合成实验室或计算平台。研究人员只给出一个宏大的目标,如“寻找一种能更高效固碳的纳米材料”。AI必须在海量假设中筛选最优路线,指导机器人进行实验,并根据实验回传的实时数据,动态调整自己的假设。

当实验数据与初始理论冲突时,AI能否迅速识别出是模型偏差还是实验误差的反思能力,成为衡量其是否“聪明”的黄金标准。那些能够通过少量实验修正自身知识结构、进而逼近真理的AI,才被认为具备了真正的科学直觉。

然而,即便是最先进的AI,在科学领域的表现依然面临界限。我们衡量AI,并非为了证明它能取代科学家,而是为了确立一种全新的协作范式。

科学研究不仅需要逻辑推演,还需要那种打破范式的“直觉”。目前,AI擅长在既定的科学空间内进行海量的、高维度的搜索与优化,但在提出颠覆性的科学假说、或在模糊的交叉学科边缘进行原创性飞跃方面,人类科学家依然掌握着主导权。

我们距离创造出一个能够独立从事科学研究的“数字科学家”还有多远?《科学》这篇文章的结论或许可以给予我们启发:这取决于我们的评估体系演进得有多快。

当我们不再仅仅以“考试成绩”来衡量模型,而是以“逻辑严谨度”、“实验修正能力”和“跨学科泛化能力”为坐标系时,我们不仅在筛选更好的工具,更是在重新定义科学本身。

在这个人机共进的时代,衡量AI的过程,本质上也是人类在不断审视自身如何理解自然界的过程。

https://www.science.org/content/article/how-will-we-know-if-ai-smart-enough-do-science

Deep Science预印本

。