AI时代,曾经最简单的事,如今却成了最大的问题

本文来自微信公众号: 不懂经 ,作者:不懂经也叔的Rust

小时候,我们常问一些看起来“很天真很傻”的问题:

•为什么世界上有贫困?

•为什么有人会相信明显错误的事情?

这些问题看似简单,其实背后藏着极为复杂的逻辑。但如果你思考得足够深入,会发现这些问题问反了。

真正值得追问的不是“为什么有贫困”,而是“为什么会有财富”;不是“为什么有人犯罪”,而是“为什么大多数人守法”;不是“为什么人会相信假话”,而是“为什么人会相信真相”。

在人类社会中,真相从来不是默认项。而AI时代的到来,让“真实”这件事,第一次变成了一种显眼、稀缺、甚至需要刻意维护的东西。

AI正在重写我们与“现实”的关系。它不是帮你获取知识,它是在重构你的信念。AI生成的环境,不是帮助你判断,而是在消耗你的判断力,而你可能还浑然不觉。

在这样的时代,知道什么是真的,不再是常识,而是一种能力,一种特权,甚至是一种生存优势。

为什么聪明人正在纷纷逃离社交媒体?

人类并不是天然就会相信真相

想象一个再普通不过的场景。

一个孩子在放学路上忽然问妈妈:“为什么世界上会有穷人?”大多数大人都会给出类似的回答:“因为有坏人剥削他们。”这个回答听起来很顺耳,也很符合直觉。但它几乎是错的。

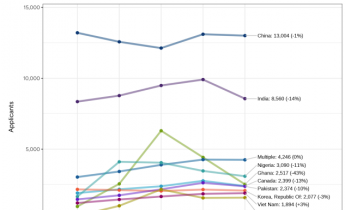

如果我们看一下过去两千年全球GDP的图表,会发现一条漫长而平坦的死线,然后直到最近两三百年才突然像火箭一样垂直升起。

可以说,在人类历史的绝大部分时间里,无论是君主还是农奴,按今天的标准看,都生活在极度的匮乏中。贫困并不是什么谜题,贫困是人类的默认状态,就像地心引力一样自然。只要你不做任何努力,你就会自动掉入贫困。

正如亚当·斯密所意识到的,真正令人费解、真正需要解释的谜题,从来不是“贫困的起源”,而是“财富的起源”。

人类是如何在某一个瞬间,突然挣脱了马尔萨斯陷阱,创造了前所未有的繁荣?这才是奇迹。这也是我们理解“真相”的第一把钥匙。

我们大多数人都有一个名为“朴素实在论”(Naive Realism)的思维错觉。我们认为:我看世界是什么样,世界就是什么样;真理就在那里,像地上的石头一样,捡起来就是了。如果有人不信真理,那肯定是因为他们蠢,或者坏。

但现实恰恰相反。无知和误解,才是人类认知的“默认状态”,就像贫困是经济的默认状态一样。

财富并不是自然生长出来的。它依赖的是一整套高度复杂、脆弱、并且极不稳定的制度组合:产权、法治、市场、分工、科学、信用体系。这些东西一旦瓦解,社会会迅速滑回贫困。

我们今天能知道地球绕着太阳转,能知道细菌致病,能知道通胀的基本逻辑,并不是因为人类突然变聪明了,而是因为在过去几百年里,我们一点点搭建起了一套用来对抗无知与错觉的认知制度。

在这套制度出现之前,人类对世界的理解,大多数时候都是错的,而且错得非常自信。

所以,相信真相不是本能,而是一种极其罕见的文明成就。

AI暴击下,科技行业增长最快的新工作居然是这个

真相不是自然状态,而是制度产物

一百多年前,美国政治评论家、新闻理论奠基人沃尔特·李普曼(Walter Lippmann)就在其著作《公众舆论》(Public Opinion,1922)中,准确描述了我们认知世界的方式。

他写道:“我们不是直接面对现实世界,而是活在我们脑海中对现实的图像之中。”他称之为“拟态环境”(pseudo-environment)。

李普曼指出,现代人理解世界的方式,并不是通过直接经验获得真相,而是依赖于由他人提供的信息、叙述和解释拼接而成的世界图景。这种拟态环境塑造了我们的看法、判断和信念,但它并不总是准确。

尤其是现代社会,我们要处理的信息,如宏观经济、疫苗原理、国际地缘政治、气候变化,没有一个是你能亲眼看见的。我们所有的认知,都经过了无数道中介的折射:记者、专家、算法、朋友圈、意见领袖……

在这个过程中,只要有一个环节出错,或者我们自己的私心、部落本能稍微作祟一下,我们就会偏离真相。

这就意味着,“搞错事情”是容易的,“弄清真相”是极度困难的。

我们今天之所以还能在一定程度上区分事实与虚构,是因为我们继承了一套极其昂贵的文明遗产:科学方法、同行评审、新闻伦理、司法程序、学术规范。

这些制度并不完美,但它们有一个共同点:它们都在强迫人类对抗自己的直觉。

科学要求证据而不是感觉;同行评审让对手来挑你的毛病;新闻规范要求核查而不是转述;司法程序通过对抗逼近事实。

这套体系的存在,本身就是为了限制人类那种爱听故事、爱站队、爱自我确认的天性。

“相信真相”本身就是一种文明的奇迹

哲学家约瑟夫·希思提出过一个非常有启发性的概念,叫“解释性反转”。

他说,区分常识思维和科学思维的关键,不在于答案,而在于你到底认为什么东西需要解释。

比如在犯罪问题上,常识会说:大多数人守法,犯罪是异常现象,所以我们要研究“人为什么犯罪”。

但如果你真正分析犯罪动机,就会发现事情恰恰相反。抢劫是因为有钱可拿,暴力是因为愤怒失控,欺诈是因为收益高风险低。这些动机一点都不稀奇,几乎人人都有。

真正令人震惊的,其实是另一件事:为什么大多数人,在大多数时候,竟然没有犯罪?

答案并不浪漫。是法律、惩罚、羞耻感、社会评价、内化的道德规范,是一整套缓慢形成、成本极高的社会机制,在勉强压住人性中更原始的一面。

把这个逻辑放到认知领域,结论会更加惊人。

从心理结构上看,人类的大脑并不是为“寻找真相”而设计的。我们更容易接受简单的解释、情绪化的故事、符合立场的信息。阴谋论、偏见、以偏概全,对大脑来说都是省力的。

认知科学家、心理学家史蒂芬·平克(Steven Pinker)多次指出:人类心智的首要目标从来不是“正确理解世界”,而是“在复杂环境中活下来”。

对远古人类而言,快速做出“足够好”的判断,远比慢慢逼近真相更有生存价值。一个过度追求精确、反复验证的祖先,很可能在犹豫中被捕食者淘汰。

更激进的观点来自认知科学家唐纳德·霍夫曼(Donald Hoffman)。他提出,人类的感知系统并不是现实的镜子,而更像一个“用户界面”。

在他的理论中,自然选择并不会奖励“看见真相”的生物,而是奖励“高效行动”的生物。真实、完整、精确的世界模型,不但昂贵,而且是进化上的负担。

从这个角度看,“接近真相”反而是一种反进化的行为。它消耗更多能量,需要更多训练,要求个体压制直觉、延迟判断、承受不确定性,这些都与大脑的默认偏好背道而驰。

也正因为如此,相信真相才不是人类的自然状态,而是一种被制度、文化和训练强行塑造出来的例外,是一种文明的奇迹。

网红时代终结,但每个人仍可以在自己的“梯子顶端”获得成功

AI时代:真相的“脚手架”正在被系统性瓦解

真相是脆弱的制度产物,而非自然状态。明白了这一点,我们才能真正理解,为什么AI时代的到来,让我们面临着一场前所未有的认知危机。

在AI出现之前,制造谎言虽然容易,但至少还需要一点成本。你需要雇人写软文,需要PS图片,需要组织水军。

但现在,生成式AI让这一切的边际成本变成了零。它所带来的冲击,远不止是“信息通胀”这么简单。它所引发的,实际上是对人类在现代社会建立的认知结构的瓦解。

生成式AI几乎可以无限制造看起来“像是知识”的东西:伪造的学术论文、逻辑自洽的胡说八道、深度伪造的视频、貌似真实的音频……最可怕的是,这些内容不需要对错,不需要证据,它们只需要符合语言习惯,听起来“像那么回事”。

AI是一种超级强大的“自动补全机”,它并不理解内容本身,而是通过大数据模型猜测你想听的下一个词是什么。结果就是,它生成的文本经常比真相更像真相,因为它符合我们的语言期待,逻辑连贯,还自带一种令人放松的语调和节奏。

这会直接污染我们的大脑,污染我们所生活的“拟态环境”,那个我们依靠它来理解世界的心理模型。

游戏真的变了,当“大空头”关掉基金开了付费群

而污染还不是终点。真正致命的,是信任的崩塌。

法学教授Bobby Chesney曾提出一个令人警醒的概念:“骗子红利(Liar’s Dividend)”。

他的意思是,当虚假内容泛滥到一定程度,连真实的证据都将失去效力。花于是人人都会更倾向于去造假。

比如,一段政治人物的深度伪造视频在网上疯传,即便后来有权威机构出面辟谣,受众也可能不再买账。而当真正的监控视频被公之于众时,作恶者甚至可以振振有词地说:“那是AI合成的。”

这将导致一种极端危险的社会心理状态:人们不再去验证,不再去追问,而是直接放弃判断。

他们会退回到认知的默认模式,只相信我愿意相信的,只相信我这个群体的说法,只相信能带来情绪满足的内容。

也就是说,我们不是变得更理性了,而是更部落化、更情绪化、更退化。但最深层的危机,还在于整套保护真相的“制度性脚手架”正在被系统性瓦解。

我们前面提到过,那些让真相得以被发现、被确认、被传播的制度,如科学、媒体、法律、教育,本质上都是建立在人类产生信息、并对其负责的前提之上。可一旦AI进入内容生产环节,这一前提就开始失效:

·学术界,同行评审面对的是AI批量生成、风格雷同、难以溯源的伪论文;

·新闻业,调查记者要和无数AI垃圾内容农场竞争注意力;

·司法系统,法官面对的是无法判断真伪的合成证据、音视频伪造;

·教育系统,老师面对的是学生用AI写作、思维松散、缺乏基础逻辑能力……

这些并不是“认知负担加重”这么简单,而是整个认知制度的逻辑基础被破坏了。更直白一点说,我们过去赖以建立“共识真相”的机制,正在被大规模拆解。

在AI时代,“验真”才是最重要的能力

在这个意义上,“验真”(Verification)将成为AI时代最重要、也最稀缺的一种劳动形式。

它不再是后端修正的辅助工作,而是前端认知的核心任务。不是更快地产出,而是更谨慎地确认;不是更多表达,而是更少但更可靠的判断。

在过去,信息的生产是一种稀缺资源,谁掌握话语权,谁就掌握影响力。而在AI大模型将内容生产“商品化”、甚至“泡沫化”的时代,稀缺的东西变了。真正珍贵的,不再是信息本身,而是信息的来源、路径、验证方式,以及它能不能被信任。

前OpenAI研究科学家安德烈·卡帕西(Andrej Karpathy)曾公开表示,在AI生成内容无处不在的时代,拥有“验证能力”的人将变得极其重要。他甚至说,未来我们每个人都需要训练一个“AI验真助手”,否则人类将被包裹在由幻觉构成的世界里而不自知。

同样,硅谷著名投资人、前Coinbase CTO巴拉吉·斯里尼瓦桑(Balaji Srinivasan)也指出:我们正在进入一个“验证即权力”(Verification is power)的时代。在他看来,AI重塑了信息的成本结构与信任结构,未来最有价值的,不是传播者,而是验证者。谁能为真相担保,谁就能建立新的社会权威。

换句话说,未来世界不缺内容,也不缺工具,缺的是可信度。

AI生成的内容越是泛滥,我们越可能会进入一个“小圈子信任”的时代。既然公域流量充满了AI生成的噪音,我们会更加依赖那些经过长期验证的、有信誉的个人和机构。

那些能够持续提供经过核实的、真实的、有洞察力信息的个人或组织,将获得前所未有的溢价。因为他们出售的不再是信息,而是“确定性”。

叙事为王的时代:别再把努力浪费在“做对”的事情上

在幻觉与深伪密布的世界中,重寻“认知部落”

在人类社会中,真相从来不是默认项。在AI带来的信息爆炸中,真相不是被自动提供的公共资源,而是一种需要不断验证、维护和捍卫的文明成果。

而今天,我们正在经历某种进化意义上的“倒退”:曾经帮助我们构建真相的认知制度——科学、媒体、教育、法律,正面临前所未有的系统性冲击。信息泛滥、信任坍塌、幻象横行,正在将整个公共认知空间变成一片泥沼。

当公域被噪音淹没时,人类会本能地向“部落”回退。

只不过这一次,我们不再回到地理意义上的村落,而是转向那些小而美、深且真的“认知共同体”。我们开始依赖那些经过时间筛选、信任积累、洞察验证的个体与小团体。不是因为他们说得最响、发得最多,而是因为他们说得最真、想得最深、看得最准。

这也许正是我们重新理解“知识”和“社群”的时刻。

从进化的角度来看,人类之所以能在弱肉强食的自然界中生存下来,并不是因为个体强大,而是因为我们善于构建协作网络、共享判断、彼此提醒。

在AI时代,这个“合作型物种”的本能将再次显现。加入一个高质量、可信度高的社群,不是为了获取更多信息,而是为了在混乱中拥有一种稳定的认知锚点,一种共同求真的文化默契。

在未来,确定性就是稀缺品,判断力就是生存力。拥有一个值得信赖的“认知共同体”,可能是我们穿越幻象时代最重要的装备之一。【懂】

。